대화형 인공지능(AI) 챗GPT뿐 아니라 운전, 의료 등 많은 분야에서 AI가 쓰이고 있어요. AI가 각종 정보를 분류하고, 새로운 결과물을 생성하려면 다양한 정보를 학습하는 과정이 필요해요. 이번 노벨 물리학상은 AI가 복잡한 계산을 할 때 쓰는 학습 기술, 인공신경망을 발전시킨 과학자들에게 주어졌습니다.

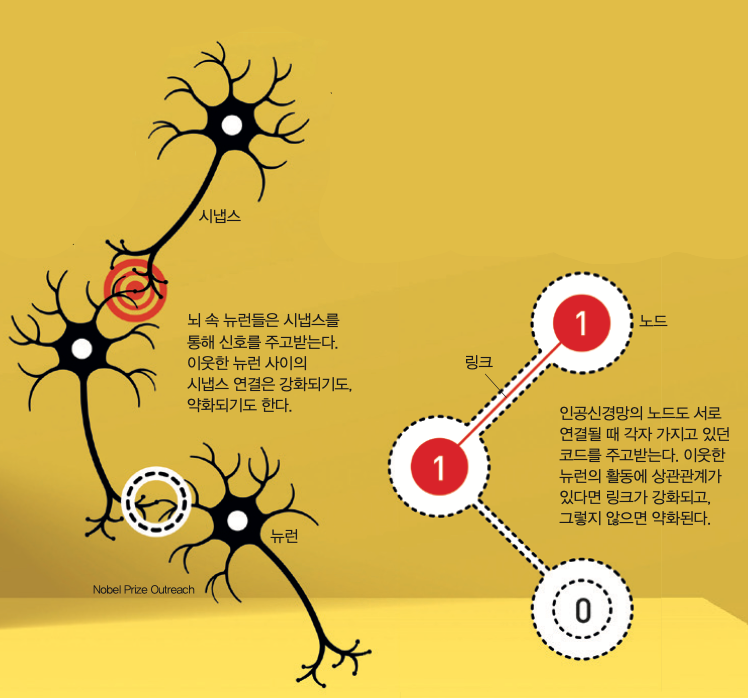

우리의 뇌 속에는 신경계를 구성하는 세포인 뉴런이 있습니다. 뉴런은 외부로부터 받은 자극을 척수, 뇌, 근육 등으로 전달하고, 뉴런이 서로 이어지는 부위인 시냅스를 통해 다른 뉴런과 신호를 주고받기도 해요. 뉴런 덕분에 우리는 새로 배운 것을 기억하고, 생각하고, 몸을 마음대로 움직일 수 있죠.

1940년대부터 과학자들은 뉴런과 시냅스에서 아이디어를 얻어 이를 그래프처럼 나타내기 시작했어요. 이것이 바로 인공신경망이죠. 인공신경망은 사람의 신경계처럼 정보를 기억하고 처리하는 알고리즘입니다. 존 홉필드 교수는 특정한 정보를 저장하고 그 정보를 재현하기도 하는 인공신경망, 홉필드 네트워크를 1982년에 공개했습니다.

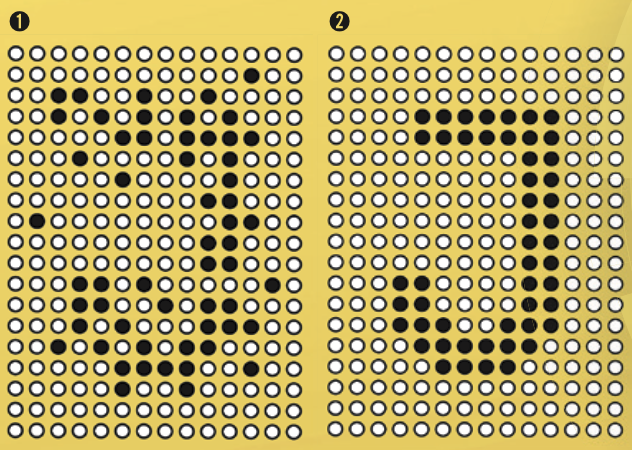

홉필드 네트워크는 뉴런과 다른 뉴런의 연결을 그래프 형태로 표현한 모형이에요. 뉴런 역할을 하는 ‘노드’와 시냅스 같은 역할의 ‘링크’가 있죠. 노드는 정보를 접하면 0 또는 1로 나타내요. 만약 불안정하거나 왜곡된 정보가 주어지면 기존에 저장했던 것 중 가장 비슷한 정보를 찾아서 나타냅니다. 이를 ‘연상 기억’이라고 해요. 정보가 부분적으로 지워져 있으면 평가를 거쳐서 해당하는 부분을 다시 만들 수도 있어요.

한편 제프리 힌튼 교수는 1985년 볼츠만 머신이라는 인공신경망을 발표했습니다. 볼츠만 머신은 숨은 노드를 추가해 네트워크를 거미줄처럼 구성한 알고리즘이에요. 볼츠만 머신에서 발전한 모형인 ‘제한된 볼츠만 머신’은 계산을 더 효율적으로 하게끔 개선됐죠. 이처럼 계산하는 층이 여럿인 신경망이 등장하자 한 네트워크의 노드 수는 수조 개까지 늘어나고, AI는 더 많은 정보를 효과적으로 학습할 수 있었습니다.

홉필드 네트워크는 부정확한 정보를 그대로 인식하던 이전 알고리즘과 달리, 계속 평가를 거쳐서 정보를 처리해요. 볼츠만 머신은 AI 스스로 심층 학습을 해서 그림, 음악 등 결과물을 생성하는 토대가 됐죠. 서울대학교 물리교육과 조정효 교수는 “인공신경망은 AI가 인간의 설계 없이도 스스로 데이터 속 규칙들을 찾아낼 수 있도록 한 기술”이라고 말했습니다. 두 인공신경망 모형 모두 AI의 심층 학습이 가능한 배경을 만든 셈이에요.